Quando o algoritmo amplifica a violência

Trend ‘caso ela diga não’ evidencia como algoritmos amplificam violência e desafiam a governança das plataformas digitais

- Publicado: 27/03/2026 15:45

- Alterado: 27/03/2026 15:45

- Autor: Redação

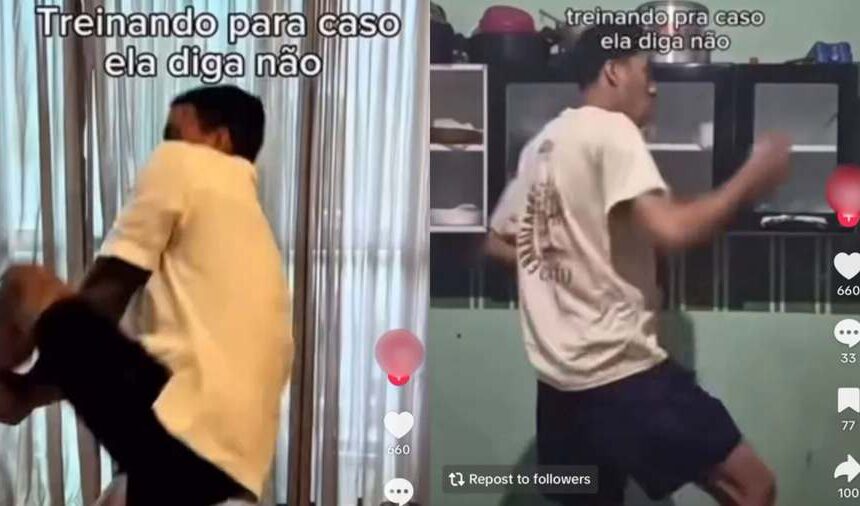

- Fonte: Fernando Manfrin

Nos últimos dias, uma tendência que viralizou nas redes sociais provocou forte reação pública e mobilizou autoridades brasileiras. A chamada trend “caso ela diga não” consiste em vídeos nos quais homens simulam situações de rejeição amorosa e, diante da negativa da mulher, encenam atos de agressão física ou até morte. O conteúdo, disseminado principalmente em plataformas de vídeo curto, levou a Polícia Federal a abrir investigação por possível incitação à violência contra a mulher.

O fenômeno da trend “caso ela diga não” e sua repercussão no Brasil

À primeira vista, muitos desses vídeos são apresentados como “humor”, encenação ou exagero típico da linguagem das redes sociais. No entanto, o fenômeno levanta uma questão jurídica e social mais profunda: qual é o limite entre liberdade de expressão e a normalização simbólica da violência em ambientes digitais amplificados por algoritmos?

No Brasil, o Marco Civil da Internet estabelece que plataformas digitais podem ser responsabilizadas caso não removam conteúdos ilícitos após ordem judicial. Entretanto, à medida que sistemas automatizados passam a desempenhar papel ativo na promoção e recomendação de conteúdos, cresce no debate internacional a percepção de que o problema não se restringe ao conteúdo em si, mas também à lógica de amplificação algorítmica que sustenta a chamada economia da atenção.

Diversos estudos já demonstraram que conteúdos violentos, polarizadores ou emocionalmente extremos tendem a gerar maior engajamento nas redes sociais. Isso cria um incentivo estrutural para que tais conteúdos circulem com maior intensidade, mesmo quando podem contribuir para a normalização simbólica de comportamentos nocivos.

No caso específico da violência de gênero, essa dinâmica torna-se particularmente preocupante. A banalização da violência contra mulheres, ainda que apresentada em formato de “humor” ou encenação, pode contribuir para reforçar padrões culturais que relativizam agressões e naturalizam comportamentos abusivos.

O papel dos algoritmos e a normalização da violência nas redes sociais

Por essa razão, debates recentes sobre regulação digital têm enfatizado a necessidade de uma governança algorítmica mais robusta. Em vez de tratar as plataformas apenas como intermediárias passivas, esse modelo reconhece que sistemas de recomendação e curadoria automatizada exercem influência significativa sobre o ambiente informacional e, consequentemente, sobre o impacto social dos conteúdos que circulam nas redes.

Experiências internacionais mostram que essa discussão já avançou em diversas jurisdições. Na União Europeia, por exemplo, o Digital Services Act (DSA) passou a exigir que grandes plataformas adotem medidas de mitigação de riscos sistêmicos associados ao funcionamento de seus algoritmos, incluindo riscos relacionados à violência, discurso de ódio e manipulação informacional. O regulamento também impõe obrigações de transparência sobre sistemas de recomendação e mecanismos de auditoria independente.

Nos Estados Unidos, embora o modelo regulatório seja mais fragmentado, órgãos como a Federal Trade Commission (FTC) têm ampliado o escrutínio sobre práticas algorítmicas potencialmente danosas. A discussão também ganhou força no âmbito do NIST AI Risk Management Framework, que incentiva empresas a incorporar mecanismos de gestão de risco e governança responsável no desenvolvimento e uso de sistemas de inteligência artificial.

Experiências internacionais e o potencial da IA na prevenção de conteúdos nocivos

Outro aspecto que merece atenção é o próprio potencial das tecnologias de Inteligência Artificial para atuar na prevenção e mitigação de conteúdos potencialmente violentos. Plataformas digitais já utilizam sistemas de análise comportamental e processamento de linguagem natural capazes de identificar padrões associados a ameaças, discurso de ódio ou incitação à violência. Quando implementadas com critérios transparentes e supervisão humana adequada, essas ferramentas podem contribuir para a detecção precoce de conteúdos problemáticos, permitindo intervenções mais rápidas de moderação e a preservação de evidências digitais que auxiliem investigações conduzidas por autoridades.

A discussão provocada pela trend “caso ela diga não” revela que o problema não está apenas nos vídeos isoladamente considerados, mas no ambiente tecnológico que permite que determinados tipos de conteúdo ganhem escala e visibilidade em poucos minutos.

À medida que as redes sociais se consolidam como infraestrutura central do debate público, torna-se cada vez mais necessário discutir não apenas o que é publicado nas plataformas, mas também como seus sistemas de recomendação operam e quais responsabilidades devem acompanhar o poder tecnológico que essas empresas exercem sobre a circulação da informação.

Fernando Manfrin

Fernando Manfrin, advogado especialista em compliance e data privacy.